随着人工智能和大数据技术的飞速发展,机器学习已成为解决复杂问题的关键工具,在机器学习领域,训练误差的减小对于提高模型的性能至关重要,本文将探讨如何不断减小训练误差,以优化机器学习模型的表现。

理解训练误差

训练误差是机器学习模型在训练过程中产生的预测误差,它是衡量模型性能的重要指标之一,反映了模型对未知数据的泛化能力,训练误差越小,模型的预测能力越强,性能越稳定,减小训练误差是提高机器学习模型性能的关键环节。

减小训练误差的方法

1、数据预处理:数据是机器学习模型的基础,通过数据清洗、去噪、归一化等手段,可以提高数据质量,从而减小训练误差,采用合适的数据增强技术可以增加数据量,提高模型的泛化能力。

2、特征工程:特征工程是提取和转换数据特征的过程,对于模型的性能至关重要,通过选择有意义的特征、降维等方法,可以提高模型的表达能力,进而减小训练误差。

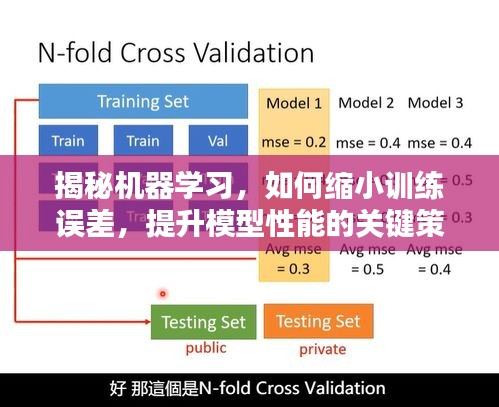

3、模型优化:选择合适的模型结构和参数是提高模型性能的关键,通过调整模型的复杂度、优化超参数、引入正则化等技术手段,可以减小训练误差,采用集成学习方法,如bagging和boosting,也可以提高模型的性能。

4、损失函数设计:损失函数是衡量模型预测值与真实值之间差距的指标,设计合适的损失函数对于减小训练误差至关重要,根据具体任务选择合适的损失函数,如均方误差损失、交叉熵损失等,可以更好地指导模型的训练过程。

5、使用深度学习技术:深度学习技术通过构建深度神经网络来提取数据的层次特征,可以显著提高模型的性能,随着深度学习技术的发展,卷积神经网络(CNN)、循环神经网络(RNN)等结构在图像、语音、文本等领域取得了显著成果,通过引入深度学习方法,可以更有效地减小训练误差。

6、迁移学习:迁移学习是利用预训练模型在新的任务上进行微调的方法,通过利用预训练模型的参数和知识结构,可以在新的任务上快速构建高性能模型,从而减小训练误差。

7、持续学习:在持续学习的框架下,模型可以在不断获取新数据的过程中进行增量学习和调整,这种方法可以使模型适应动态变化的环境,提高模型的泛化能力和适应性,从而减小训练误差。

实践中的挑战与解决方案

在减小训练误差的过程中,可能会遇到一些挑战,如过拟合、欠拟合、局部最小值等问题,针对这些问题,可以采取以下解决方案:

1、过拟合:过拟合是模型在训练数据上表现过好的现象,但在测试数据上表现较差,可以通过增加数据量、采用正则化、早停法等技术手段来缓解过拟合问题。

2、欠拟合:欠拟合是模型在训练数据上表现不佳的现象,可以通过增加模型的复杂度、调整优化器、引入更多的特征等方法来解决欠拟合问题。

3、局部最小值:在优化过程中,模型可能会陷入局部最小值,导致无法找到全局最优解,可以采用梯度下降法、随机梯度下降法等优化算法来避免陷入局部最小值。

减小训练误差是提高机器学习模型性能的关键路径,通过数据预处理、特征工程、模型优化、损失函数设计、使用深度学习技术、迁移学习和持续学习等方法,可以不断减小训练误差,提高模型的性能,在实践过程中,需要关注过拟合、欠拟合和局部最小值等挑战,并采取相应的解决方案,随着技术的不断发展,相信未来会有更多有效的方法出现,帮助我们更好地减小训练误差,提高机器学习模型的性能。

转载请注明来自大成醉串串企业,本文标题:《揭秘机器学习,如何缩小训练误差,提升模型性能的关键策略》

蜀ICP备2020032544号-3

蜀ICP备2020032544号-3

还没有评论,来说两句吧...